游戏简介

MNN Chat手机大模型支持多种大型模型框架,包括DeepSeek、Llama、Qwen、Gemma等,便于灵活部署。MNN

Chat手机大模型软件下载内置CPU与GPU优化算法,可高效执行模型推理并显著提升响应速度。同时MNN

Chat也支持文本生成、图像识别及音频处理的多模态任务,适用于多场景应用。

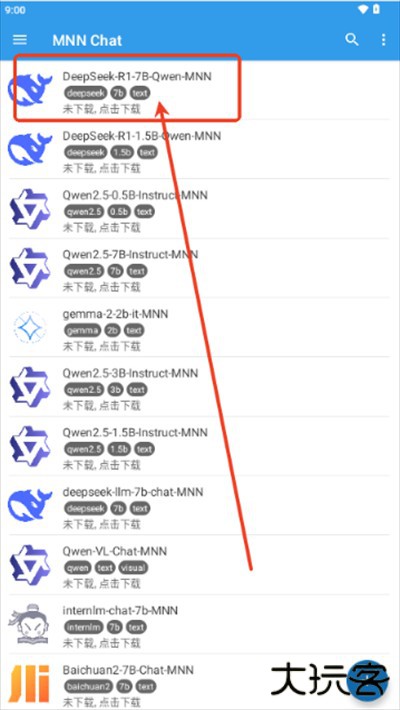

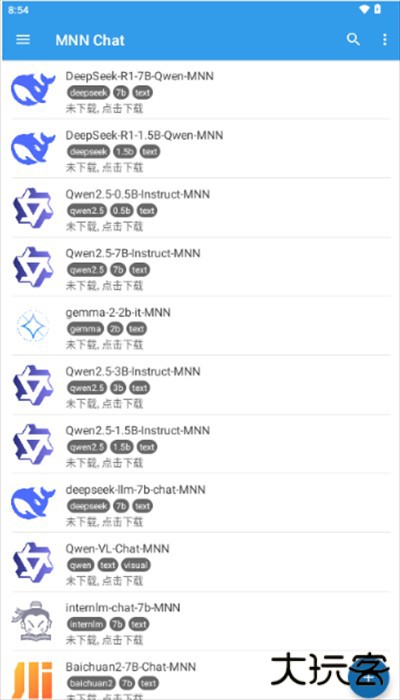

1、首先,从本站下载MNN Chat手机大模型最新版本;

2、打开软件后,根据个人需求选择想要部署的AI模型;

3、请注意,为确保本地部署顺畅,手机需预留至少10GB的内存空间;

4、模型下载完毕后,即可通过该软件与AI进行流畅的对话交流;

5、软件支持多语言输入,无限制词聊天,且本地部署模式下无需网络连接即可使用。

MNN(Mobile Neural Network)是阿里巴巴开源的轻量级推理框架,专为移动端与嵌入式设备优化。

1、它支持TensorFlow、Caffe、ONNX等主流模型格式,并适配多种神经网络结构。

2、框架具备模型量化与压缩能力,可有效降低体积并提升运行速度。

3、无需依赖特定NPU,也能在普通CPU和GPU上高效完成模型推理。

4、支持跨平台部署,可运行于Android、iOS、Linux等多种系统。

5、广泛用于图像识别、语音处理、智能家居与工业检测等AI场景。

【多模态支持】支持文本、图像及音频输入输出,实现多类型AI交互。

【模型量化优化】FP16/Int8量化技术可将模型体积减少50%~75%。

【CPU/GPU加速】深度优化算子性能,充分利用设备算力提升推理速度。

【多模型兼容】兼容DeepSeek、Llama、Qwen、Gemma等主流开源模型框架。

【本地部署】无需联网即可在手机端独立运行,保障数据隐私安全。

【Mini编辑模式】可压缩软件包体积,减少基础库约25%,提高存储利用率。

1、本地运行大型AI模型,实现多模态交互功能,体验快速高效的推理表现。

2、内置模型量化与压缩技术,有效减少模型占用空间,同时保持高性能表现。

3、支持多种主流模型框架,灵活适配不同场景,完成复杂数据处理任务。

4、MNN Chat手机大模型内置Mini编辑模式,提高手机存储和运算效率。

v0.5.1.1

-修复了一些已知问题,提升了稳定性。

-优化了用户界面,提升了使用体验。

游戏信息

更多资讯MORE +

相关专题MORE +